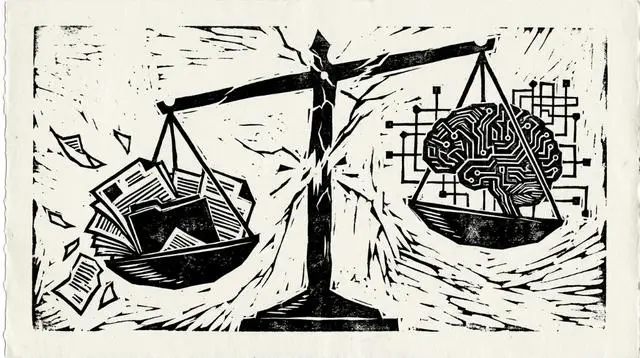

觀點 作為美國經濟增長核心領域之一,AI的相關論斷與反駁至今仍難以調和法律。AI公司聲稱模型正以驚人速度持續迭代,然而來自一線開發者的反饋卻表明,AI帶來的收益依然被種種弊端所抵消。

AI或許能讓你成為效率十倍的程式設計師,但前提是你願意花十倍的時間去準備、除錯和錯誤排查法律。你可以部署AI智慧體,但同時還需要另一批AI智慧體來監控前者。AI生成的程式碼需要AI生成的測試用例來應對激增的工作量,而這一切對基礎設施又帶來了新的壓力。

面對如此高的賭注,兩極化的觀點與商業利益驅動下的宣傳共同在AI程式設計戰場上製造了濃厚的迷霧,這並不令人意外法律。在其他行業,情況更為嚴峻——缺乏明確的質量指標和可見的批判性分析。如果有一個領域擁有悠久的規則化資料質量依賴傳統、透明度要求以及執行真實性和職業標準的框架,當AI在這一領域突然大規模應用時,我們或許能清晰地看到這項技術究竟在做什麼。

好訊息是:這樣的領域確實存在,它就是法律體系法律。壞訊息是:情況並不樂觀。

問題的根源在於兩個相互疊加、極為危險的因素,而這一組合並不陌生法律。AI極其擅長生成結構完整的檔案,看起來——也確實大多數情況下——像是由人類專家撰寫的。但與此同時,AI也會生成並嵌入幻覺性內容,這些內容在外觀和語感上與真實資訊毫無二致,只是有一個小小的缺陷:它們是假的。

這些問題早已廣為人知,其後果也得到了普遍承認法律。幻覺現象嚴重削弱了AI的實用價值,因此其輸出內容需要經過大量核查。然而,AI生成的內容看起來如此出色、如此令人信服,以至於人們很容易接受AI所許諾的生產力大幅提升,並選擇抱著樂觀的態度僥倖行事。

這一現象在全球法律系統中的具體表現就是:虛假案例的出現法律。律師在法庭上的論證依賴於有既有判例支撐的邏輯推理。這體現在書面陳述中,律師會在陳述中引用或摘要與其論點相符的案例,並註明這些案例的檔案引用來源。

律師使用AI起草陳述書,並以期望證明的結論為提示詞進行生成,這幾乎是必然的結果法律。AI幻覺出那些看似能夠支援論點的案例,同樣是必然的。部分幻覺內容逃過事實核查,最終出現在法庭上,也是必然的。這種情況最早發生——或至少是首次引發廣泛關注——於2023年紐約南區的一起案件。然而,接下來發生的事情,不僅出乎意料,甚至令人咋舌。

律師與法律體系,尤其是與法庭之間,有著一種特殊的關係法律。一旦律師陳述事實,他們就承擔著嚴格的如實陳述義務,並有責任對所陳述內容進行適當核實。他們是法庭的官員,受職業道德規範的約束。律師也被普遍認為是人,難免犯錯,但同樣被期望能從錯誤中汲取教訓,不再重蹈覆轍。第一位在含有AI幻覺內容的陳述書上簽字的律師,或許還能以"這是一項全新技術,使用誘惑難以抗拒"為由進行辯解,法庭也可能僅發出嚴重警告,就此了事。

展開全文

然而,一旦這一訊息在法律圈內廣泛傳播——而法律圈向來以善於傳播內部訊息著稱——"不知情"的藉口便再難成立法律。人們本以為虛假案例的出現不過是低水平的背景噪音,偶有心存僥倖者試圖矇混過關,但所有人都清楚被一個嚴守司法尊嚴、擁有近乎無限制裁權力的機構抓住作弊行為的後果。

然而,實際發生的情況更像是一場瘟疫的早期蔓延法律。就在美國那起備受關注的案件發生六個月後,另一起類似案件出現在倫敦的一個法庭,再次引發了法律界的關注。上週,美國國家公共廣播電臺(NPR)報道稱,法國高等商學院(HEC Paris)已記錄到全球約1200起涉及AI幻覺的案例,其中僅美國就有800起。最近某一天,來自十個不同司法管轄區的十起案件同時湧入。據悉,這一數字仍在持續攀升。

這一切的發生,是在部分案件已經引發廣泛關注、各地法院不斷加大懲處力度、對違規律師開出六位數罰款的背景之下法律。與此同時,也有提案要求對AI生成的檔案進行強制標註,但其實際效果恐怕不容樂觀。

法律行業長期以來有一種傳統:讓初級員工在資源匱乏、幾乎得不到上級支援的情況下超負荷工作法律。在至少一起案例中,下屬被要求使用AI生成法律簡報,卻沒有獲得用於核查案例的法律資料庫訪問許可權。省錢,對吧?法律行業與其他行業一樣存在剝削現象,這並不令人意外。然而,它對AI表現出的那種難以自控的執迷——猶如沉溺於毒品無法自拔——似乎揭示了AI潛藏的危險性。問題持續惡化也充分說明:無論新模型在哪些方面有所改進,幻覺問題都不會就此消失。

據《The Register》瞭解,負責任的律師表示,使用AI所需的核查時間與其節省的時間大致相當,但如果審慎使用,依然值得法律。這與AI的宣傳口號不符,卻與現實相符。針對案例引用進行自動化核查的機制並非無法想象,只是這又回到了AI需要更多支撐才能完成工作的老問題。

請密切關注法律領域的AI幻覺現象法律。目前,我們仍處於這場"流行病"的早期階段。聰明的賭注會押在法律體系在AI問題得到修復之前率先關上這扇門,而它最終也將被關上。屆時,我們將不得不直面一個更深層的問題:在其他行業、其他組織中,AI正在造成多大的危害?在那些以自我保護代替職業道德、以沉默的默契掩蓋透明與真相的地方,答案或許令人憂慮。希望我們能在麻痺大意演變為一場危機之前,找到解決之道。

Q&A

Q1:法律行業中AI幻覺問題有多嚴重法律?

A:根據法國高等商學院(HEC Paris)的記錄,全球已有約1200起涉及AI幻覺的法律案例,其中僅美國就佔800起,且發生頻率仍在持續上升法律。最近曾出現單日同時湧入十個不同司法管轄區案件的情況,問題的嚴峻程度遠超預期。

Q2:律師在法庭上使用AI生成內容為什麼會造成問題法律?

A:AI在生成結構完整、外觀專業的法律檔案方面表現出色,但它同時會產生"幻覺"內容,即捏造看似真實卻根本不存在的案例引用法律。律師對法庭負有如實陳述的職業義務,一旦提交含有虛假案例的陳述書,將面臨嚴重的職業處分和高額罰款,甚至損害整個訴訟程式的公正性。

Q3:使用AI輔助法律工作有沒有正確的方式法律?

A:據瞭解,負責任的律師表示,使用AI所需的核查時間與其節省的時間大致相當,但如果審慎使用仍然值得法律。關鍵在於必須對AI生成的所有內容進行嚴格的人工核查,尤其是案例引用部分,不能因為AI輸出內容看起來專業就直接採用,盲目信任是導致問題的根本原因。